AI går in i processorernas era. Till ingens förvåning är detta dåliga nyheter för konsumenten.

Det nuvarande tillståndet för datacenter omdefinierar produktionslinjerna för de viktigaste tekniska aktörerna. Vad som verkade vara en specifik kris i priset på RAM och SSD har slutat med att bli en tsunami som sveper bort produkter och konsumentmarknaden. Datacenter behöver samma komponenter som konsumenter och resten av branschen, och det fanns en komponent som verkade säker: processorer.

Det är över. Fara! Under sin presentation av resultaten för första kvartalet 2026 gav Intel ett oroande faktum: förhållandet mellan CPU:er och GPU:er i datacenter kan snart nå 1:1.

Hittills har vi pratat om minne och GPU:er som huvudhårdvaran i datacenter, men det måste finnas en CPU som kör programmet, och för närvarande fanns det en CPU för var åttonde GPU. Men saker och ting börjar förändras på grund av agent AI. Träning är fortfarande viktigt, men nu verkar vi gå in i slutsatsernas era, och det är där CPU:er utmärker sig.

David Zinsner, Intels finanschef, beskrev i samtalet med investerare att CPU/GPU-förhållandet redan hade gått från 1:8 till 1:4 (en CPU för var fjärde GPU), men att denna agent AI exploderade minnet hos CPU:erna och närmade sig ovan nämnda 1:1. I Engadget Mycket av världsekonomin består just nu av att Google och Amazon köper grafikprocessorer: 95 % är inaktiva.

Ändra så klart. Jag tror att du nu kan förutse var skotten ska ta vägen. Som vi läser i Tom's Hardware har denna åtgärd orsakat en reaktion: att Intel börjar flytta sina produktionslinjer för att börja minska sin kapacitet inom konsumentprodukter och öka produktionen av Xeon-processorer, som är indikerade för servrar och kontinuerligt arbete.

Allt för att för närvarande leveranstider för server-CPU:er är ungefär sex månader bort och de kan inte tillåta AMD, som också har sina produkter för servrar, att slå dem i det racet.

Konsekvenser. Prishöjningar.

Utan palliativ. Xeon CPU-priser beräknas ha stigit i mars med 10 % till 20 % på grund av den bristen, men konsumentprocessorer har också ökat i pris med 5 % till 10 %. Det kommer inte att stanna där, eftersom ytterligare 10% prisökning förväntas under andra halvåret.

Faktum är att det är samma sak som med mobiltelefoner, där Intel påpekade att konsumenternas PC-marknad kommer att minska med tvåsiffriga siffror i år. Här händer det som i resten av segmenten: tillverkarna höjer priserna för alla (hyperskalare och konsumenter), men de allokerar sin produktion till datacenter eftersom det är de som kommer att köpa mest volym från dem. Intel bryr sig inte om det inte finns någon CPU för användarna eftersom det inte är huvuddelen av dess nuvarande marknad, men vad man inte har råd med är att låta hyperskalare vänta i mer än sex månader, särskilt om datacenter förväntas behöva installera fler CPU:er på kort sikt.

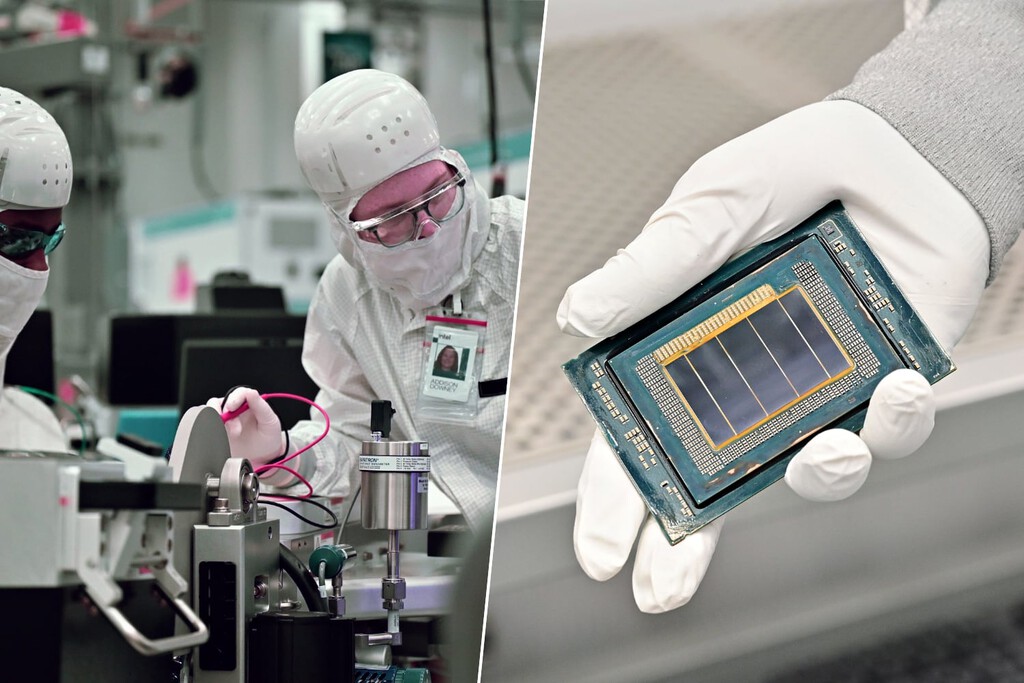

Målet: det stora gjuteriet. Intel har legat i nöden i några år. Inom konsumentsegmentet har AMD:s Ryzens slagit dem hårt, ARC GPU:erna har inte slutat gå ihop och det gick inte bra.

En rad dåliga resultat ledde till att USA:s regering investerade 8,9 miljarder dollar för att "rädda" företaget med ett mål: att göra det till det största amerikanska gjuteriet. För även om det inte gick bra är de fortfarande ett av få företag i världen som har förmågan att skapa chips, som TSMC eller Samsung. De har några av de bästa maskinerna på marknaden och den statliga räddningsaktionen började snart bära frukt hos kunder som Apple och Nvidia.

Under sin vinstsamtal för några dagar sedan rapporterade Intel en nettoförlust på 3,7 miljarder dollar, men något hände ändå: aktien steg 20%. Anledningen är att investerare inte tittar på Intels nutid, utan snarare dess framtid, och de förändringar som gjorts de senaste månaderna verkar gå i rätt riktning. På Engadget vill Microsoft minska sitt beroende av NVIDIA och se till att dess datacenter inte är ett hål i pengar: dess lösning är Maia 200.

De är inte de enda. Denna förändring av riktning och produktionslinjer är inte exklusiv för Intel. Vi har sett det i andra företag, men det är sant att de här direkt förespråkar att utelämna konsumenten för att prioritera storkunden: Big Tech.

Något liknande hände med Samsung för några dagar sedan, när det rapporterades att företaget hade börjat flytta sina LPDDR4-minnesproduktionslinjer till LPDDR5. Den här typen av minne är bättre, men också dyrare, vilket kommer att göra att enheter som tidigare monterade LPDDR4-minne (low-end miniPC eller entry- och mid-range mobiltelefoner) måste gå direkt till LPDDR5-minne som är snabbare, men också dyrare. I slutändan är översättningen densamma som alltid: som användare kommer vi att behöva dra åt bältet och hålla på med de enheter vi har ett tag till.

Hur länge? Till 2027 om du frågar några, 2028 om du frågar andra eller om det... 2030. Bilder | Intel i Xataka | Det finns ingen energi för så många datacenter och konsekvensen är tydlig: hälften av de som planeras för 2026 i USA är i fara

Originalkälla

Publicerad av Xataka

27 april 2026, 09:34

Denna artikel har översatts automatiskt från spanska. Klicka på länken ovan för att läsa originaltexten.

Visa originaltext (spanska)

Rubrik

La IA entra en la era de las CPU. Para sorpresa de nadie, es una mala noticia para el consumidor

Beskrivning

La actualidad de los centros de datos está redefiniendo las líneas de producción de los principales actores tecnológicos. Lo que parecía una crisis puntual en el precio de la RAM y los SSD, ha terminado convirtiéndose en un tsunami que se está llevando por delante productos y al mercado de consumo. Los centros de datos necesitan los mismos componentes que consumidores y el resto de la industria, y había un componente que parecía a salvo: los procesadores. Se acabó. ¡Peligro! Durante su presentación de resultados del primer trimestre de 2026, Intel dio un dato preocupante: la relación de CPU y GPU en los centros de datos podría llegar pronto a ser 1:1. Hasta ahora, hemos hablado de la memoria y las GPU como el principal hardware de los centros de datos, pero debe haber una CPU que controle el ‘cotarro’ y, actualmente, había una CPU por cada ocho GPU. Sin embargo, las cosas están empezando a cambiar debido a la IA agéntica. El entrenamiento sigue siendo importante, pero ahora parece que estamos entrando en la era de la inferencia, y es ahí donde sobresalen las CPU. David Zinsner, director financiero de Intel, describió en la llamada con los inversores que la relación de CPU/GPU ya había pasado de 1:8 a 1:4 (una CPU cada cuatro GPU), pero que esa IA agéntica estaba disparando la memoria de las CPU, acercándose al mencionado 1:1. En Xataka Buena parte de la economía mundial ahora mismo consiste en Google y Amazon comprando GPUs: el 95% están inactivas Cambio de rumbo. Creo que ya puedes adelantar por dónde van a ir los tiros. Como leemos en Tom’s Hardware, esa acción ha provocado una reacción: que Intel empiece a mover sus líneas de producción para empezar a reducir su capacidad en productos de consumo y aumentar la salida de los procesadores Xeon, que son los indicados para servidores y trabajo continuo. Todo porque, actualmente, los plazos de entrega de CPU de servidores están en unos seis meses y no pueden permitir que AMD, que también tiene sus productos para servidores, les ganen esa carrera. Consecuencias. Subidas de precio. Sin paliativos. Se estima que los precios de las CPU Xeon subieron en marzo de un 10% a un 20% debido a esa escasez, pero las CPU de consumo también aumentaron de precio del 5% al 10%. No va a quedarse ahí, ya que se espera otra subida de precio del 10% para la segunda mitad del año. De hecho, ocurre como con los móviles, con Intel apuntando que el mercado de PC de consumo disminuirá este año en doble dígito. Aquí ocurre como en el resto de segmentos: los fabricantes están subiendo precios a todo el mundo (hiperescaladores y consumidores), pero destinan su producción a los centros de datos porque son los que más volumen les van a comprar. A Intel le da igual si no hay una CPU para usuarios porque no es el grueso de su mercado actual, pero lo que no puede permitirse es tener a los hiperescaladores más de seis meses esperando, sobre todo si se espera que los centros de datos tengan que montar más CPU a corto plazo. El objetivo: la gran fundición. Intel lleva unos años de capa caída. En el segmento de consumo, los Ryzen de AMD les han ganado la tostada, las GPU ARC no han terminado de cuajar y las cosas no estaban yendo bien. Una serie de malos resultados propició que el gobierno de Estados Unidos invirtiera 8.900 millones de dólares para ‘rescatar’ la empresa con un objetivo: que fuera la gran fundición estadounidense. Porque, aunque las cosas no fueran bien, siguen siendo una de las pocas compañías del mundo con capacidad de creación de chips, como TSMC o Samsung. Tienen algunas de las mejores máquinas del mercado y ese rescate gubernamental pronto empezó a dar frutos con clientes de la talla de Apple o Nvidia. Durante la presentación de resultados hace unos días, Intel declaró pérdidas netas de 3.700 millones de dólares, pero sin embargo ocurrió algo: las acciones subieron un 20%. El motivo es que los inversores no están mirando el presente de Intel, sino su futuro, y los cambios aplicados estos últimos meses parecen ir en la dirección correcta. En Xataka Microsoft quiere reducir su dependencia con NVIDIA y que sus centros de datos no sean un agujero de dinero: su solución es Maia 200 No son los únicos. Este cambio de rumbo y de líneas de producción no es exclusivo de Intel. Lo hemos visto en otras compañías, pero sí es cierto que aquí se aboga, directamente, por dejar fuera al consumidor para priorizar al gran cliente: las Big Tech. Algo similar ocurrió con Samsung hace unos días, cuando se reportó que la compañía había empezado a mover sus líneas de producción de memorias LPDDR4 a LPDDR5. Este tipo de memorias son mejores, pero también más caras, lo que provocará que los dispositivos que antes montaban memorias LPDDR4 (miniPC de gama baja o móviles de gama de entrada y media) tengan que apostar directamente por una memoria LPDDR5 que es más rápida, pero también más cara. Al final, la traducción es la de siempre: como usuarios, nos va a tocar apretar el cinturón y aguantar con los dispositivos que tenemos durante un tiempo más. ¿Cuánto tiempo? Hasta 2027 si preguntas a unos, 2028 si preguntas a otros o ya si eso… 2030. Imágenes | Intel En Xataka | No hay energía para tanto centro de datos y la consecuencia es clara: la mitad de los previstos para 2026 en EEUU corren peligro (function() { window._JS_MODULES = window._JS_MODULES || {}; var headElement = document.getElementsByTagName('head')[0]; if (_JS_MODULES.instagram) { var instagramScript = document.createElement('script'); instagramScript.src = 'https://platform.instagram.com/en_US/embeds.js'; instagramScript.async = true; instagramScript.defer = true; headElement.appendChild(instagramScript); } })(); - La noticia La IA entra en la era de las CPU. Para sorpresa de nadie, es una mala noticia para el consumidor fue publicada originalmente en Xataka por Alejandro Alcolea .