Det finns en sak som heter "Ornn prisindex", det är utom kontroll och det är dåliga nyheter för alla

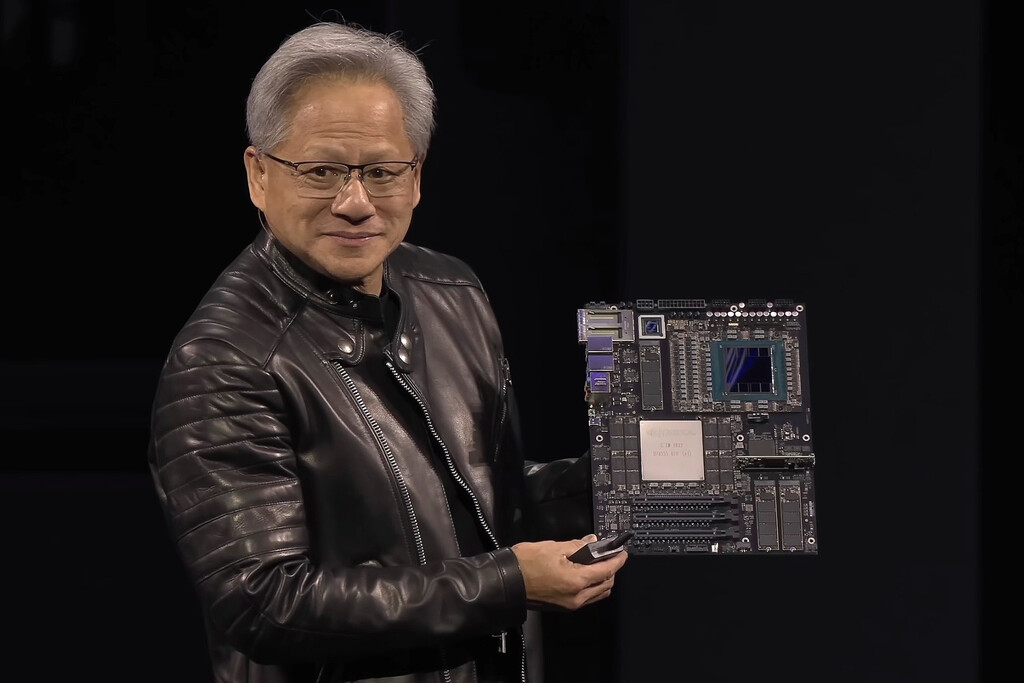

Den här veckan publicerade en analytiker vid namn Tomasz Tunguz två avslöjande diagram på X. De visar utvecklingen av vad det kostar AI-startups att få tillgång till cloud computing, och det finns dåliga nyheter. Hyrespriset för NVIDIA B200 GPU:er med Blackwell-arkitektur har gått från $2,31 per timme i början av mars till $4,95 per timme denna vecka.

Det är en ökning med 114 % på bara sex veckor och det har en tydlig orsak: ankomsten av nya modeller från Anthropic och OpenAI.

Vad graferna visar tydligt. Dessa diagram fokuserar på prisindex för Ornn, en marknad för handel med molndatorer. Den första av dem täcker priset för att hyra B200-chippen från slutet av 2025 till idag, och det finns vertikala linjer som visar varje release av de senaste modellerna från OpenAI och Anthropic.

Korrelationen är nästan perfekt: GPT-5 Codex, Claude 4.5, GPT-5.3 Codex, Claude Opus 4.7 och GPT-5.5 sammanfaller med ett hopp i prisindex. Varje gång dessa företag tillkännager en ny version av sina frontier-modeller, skjuter efterfrågan i höjden, och det gör också kostnaden. Om du vill ha det bästa, betala (mycket mer).

Den andra grafen visar prisskillnaden mellan att hyra den tidigare generationen chips, H200 med Hopper-arkitektur, och den nya B200. Det historiska genomsnittet för den "spreaden" är $1,06, men nu står den på $2,09, praktiskt taget dubbelt. Det betyder att köpare – nystartade företag och AI-företag – betalar en rekordpremie för det extra minnet och överlägsna datorkraften hos Blackwell-arkitekturchips.

Att komma åt det senaste av det senaste var redan dyrt. Nu är det ännu mer så. Detta gör också H200 till ett andraklassalternativ för de mest krävande modellerna 2026.

Action och reaktion. Det finns en överväldigande logik här. När OpenAI eller Anthropic släpper en ny modell blir det en explosion i slutsatser.

Utvecklare och företag vill testa dem så snart som möjligt och integrera dessa modeller i sina produkter (eller konkurrera med dem). För att göra detta behöver de datoranvändning snabbt, och en samtidig efterfrågan orsakas som obalanserar det tillgängliga lagret på marknaden för att hyra AI-chips per timme. Problemet är att utbudet av B200 inte växer i samma takt.

Vissa företag har velat förutse, och vi har det perfekta exemplet i Google. Han har köpt alla B200:or han kan, och det har inneburit att dessa GPU:er nu ligger runt 500 000 $ på andrahandsmarknaden enligt analytikern Jack Minor.

Effektivitetens ironi. Det märkliga är att ju effektivare dessa chips är – och B200:erna är – desto fler företag vill hyra dem samtidigt för att dra nytta av de effektivitetsfördelar som borde leda till kostnadsbesparingar. Vad som faktiskt händer är att bristen på dessa avancerade marker tar bort alla teoretiska besparingar.

I Xataka Mistral genererar inte hype, det är en diskret AI, det utlöser inte aktierna i något företag, men det tjänar redan mer pengar än Grok Långtidskontrakt. Nystartade företag och företag som tänker kortsiktigt drabbas särskilt på detta område, eftersom de möter prishopp som blir allt svårare att anta. Företag som tecknat datoruthyrningskontrakt till det dåvarande priset kan nu arbeta till mindre än hälften av sina konkurrenters kostnad.

Att tänka på medellång eller lång sikt verkar rimligt, även om återigen de som vinner är hyperskalarna och de företag som lyckats få tag i många B200:or. Och som vinner ännu mer är förstås NVIDIA, som inte klarar sig.

Få alternativ. På andra marknader som energi eller metaller finns det oftast manöverutrymme, påpekar Tunguz, men detsamma händer inte för tillfället inom AI-segmentet. På oljemarknaden, till exempel, om priset stiger med 114 % på sex veckor, kan företag köpa terminer, optioner eller leveranskontrakt till fasta priser för att skydda sina marginaler.

Vid uthyrning av molndatorer är dessa alternativ mycket mer begränsade. Och resultatet är ett mycket mer flyktigt segment.

Detta kommer att gå längre. Vi står troligen inför en topp i efterfrågan som kommer att följas av en korrigering: den nya satsen B200-chips som kommer under andra halvan av 2026 förväntas orsaka ett fall i nuvarande priser.

Men de $4,95 är nu det nya golvet, inte en topp, eftersom efterfrågan på AI-datorer kommer att fortsätta att växa snabbare än TSMC:s produktionskapacitet. Om inte utbudet av AI-chip växer markant – och det finns säkert rörelser som försöker uppnå detta, som Google med sina TPU:er, Amazon med sitt Trainium eller Huawei med sin Ascend – kommer problemet att fortsätta att finnas där. I Xataka | Europa tar sitt tekniska oberoende på så stort allvar att det siktar på det mest ambitiösa målet: NVIDIA

Originalkälla

Publicerad av Xataka

29 april 2026, 12:30

Denna artikel har översatts automatiskt från spanska. Klicka på länken ovan för att läsa originaltexten.

Visa originaltext (spanska)

Rubrik

Hay una cosa llamada "índice de precios de Ornn", está fuera de control y son malas noticias para todo el mundo

Beskrivning

Esta semana, un analista llamado Tomasz Tunguz publicó en X dos gráficos reveladores. En ellos se observa la evolución de lo que le cuesta a las startups de IA poder acceder a cómputo en la nube, y hay malas noticias. El pecio del alquiler de las GPUs NVIDIA B200 con arquitectura Blackwell ha pasado de 2,31 dólares por hora a principios de marzo a 4,95 dólares por hora esta semana. Es un incremento del 114% en tan solo seis semanas y tiene una causa clara: la llegada de nuevos modelos de Anthropic y OpenAI. Lo que los gráficos muestran con claridad. Esos gráficos se centran en el índice de precios de Ornn, un mercado de compraventa de cómputo en la nube. El primero de ellos cubre el precio de alquilar los chips B200 desde finales de 2025 hasta hoy, y hay líneas verticales mostrando cada lanzamiento de los últimos modelos de OpenAI y Anthropic. La correlación es casi perfecta: GPT-5 Codex, Claude 4.5, GPT-5.3 Codex, Claude Opus 4.7 y GPT-5.5 coinciden con un salto en los índices de precios. Cada vez que estas empresas anuncian una nueva versión de sus modelos frontera, la demanda se dispara, y también lo hace el coste. Si quieres lo mejor, paga (mucho más). El segundo gráfico muestra la diferencia de precios entre alquilar la generación anterior de chips, H200 con arquitectura Hopper, y los nuevos B200. La media histórica de ese "spread" es de 1,06 dólares, pero ahora se sitúa en 2,09 dólares, prácticamente el doble. Eso significa que los compradores —startups y empresas de IA— están pagando una prima récord por la memoria adicional y la superior capacidad de cómputo de los chips con arquitectura Blackwell. Acceder a lo último de lo último ya era caro. Ahora lo es aún más. Eso convierte además a las H200 en una opción de segunda clase para los modelos más exigentes de 2026. Acción y reacción. Hay una lógica aplastante aquí. Cuando OpenAI o Anthropic publican un nuevo modelo, se produce una explosión en la inferencia. Los desarrolladores y empresas quieren probarlos cuanto antes e integrar esos modelos en sus productos (o competir con ellos). Para eso necesitan cómputo rápidamente, y se provoca una demanda simultánea que desequilibra el inventario disponible en el mercado del alquiler de chips de IA por horas. El problema es que la oferta de B200 no crece al mismo ritmo. Algunas empresas han querido anticiparse, y tenemos el ejemplo perfecto en Google. Ha compado todas las B200 que ha podido, y eso ha hecho que estas GPUs estén rondando ahora los 500.000 dólares en el mercado secundario según el analista Jack Minor. La ironía de la eficiencia. Lo curioso es que cuanto más eficientes son estos chips —y los B200 lo son—, más empresas quieren alquilarlos a la vez para aprovechar esas ventajas de eficiencia que deberían suponer un ahorro de costes. Lo que ocurre en realidad es que la escasez de esos chips avanzados anula cualquier ahorro teórico. En Xataka Mistral no genera hype, es una IA discreta, no dispara las acciones de ninguna empresa, pero ya gana más dinero que Grok Contratos a largo plazo. Las startups y empresas que piensan a corto plazo salen especialmente perjudicadas en este ámbito, porque se enfrentan a saltos de precio cada vez más difíciles de asumir. Las empresas que firmaron contratos de alquiler de cómputo al precio de entonces pueden operar ahora a menos de la mitad del coste de sus competidores. Pensar a medio o largo plazo parece razonable, aunque una vez más quienes ganan son los hiperescaladores y aquellas empresas que han logrado hacerse con muchas B200. Y quien gana aún más es por supuesto NVIDIA, que no da abasto. Pocas alternativas. En otros mercados como el de la energía o los metales suele haber margen de maniobra, apunta Tunguz, pero no sucede lo mismo de momento en el segmento de la IA. En el mercado del petróleo, por ejemplo, si el precio sube un 114% en seis semanas, las empresas pueden comprar futuros, opciones o contratos de suministro a precio fijo para proteger sus márgenes. En el alquiler de cómputo en la nube esas opciones son mucho más limitadas. Y el resultado es un segmento mucho más volátil. {"videoId":"x9xm9vi","autoplay":false,"title":"Cómo China ha alcanzado a EEUU en la carrera de la IA en tan poco tiempo", "tag":"", "duration":"544"} Esto irá a más. Estamos probablemente ante un pico de demanda al que le seguirá una corrección: se espera que la nueva hornada de chips B200 que lleguen en la segunda mitad de 2026 provoquen una bajada de los precios actuales. Sin embargo esos 4,95 dólares son ahora el nuevo suelo, no un pico, porque la demanda de cómputo de IA seguirá creciendo más rápido que la capacidad de producción de TSMC. A falta de que la oferta de chips de IA crezca de forma significativa —y desde luego hay movimientos que tratan de lograrlo, como los de Google con sus TPU, Amazon con sus Trainium o Huawei con sus Ascend—, el problema seguirá ahí. En Xataka | Europa se está tomando tan en serio su independencia tecnológica que apunta hacia el objetivo más ambicioso: NVIDIA (function() { window._JS_MODULES = window._JS_MODULES || {}; var headElement = document.getElementsByTagName('head')[0]; if (_JS_MODULES.instagram) { var instagramScript = document.createElement('script'); instagramScript.src = 'https://platform.instagram.com/en_US/embeds.js'; instagramScript.async = true; instagramScript.defer = true; headElement.appendChild(instagramScript); } })(); - La noticia Hay una cosa llamada "índice de precios de Ornn", está fuera de control y son malas noticias para todo el mundo fue publicada originalmente en Xataka por Javier Pastor .